2023年12月29日,CCF CAD&CG专委会走进高校第17期活动在暨南大学成功举办。活动邀请了杨旭波教授(上海交通大学)、王莉莉教授(北京航空航天大学)、许威威教授(浙江大学)、杨鑫教授(大连理工大学)和汪云海教授(中国人民大学)分别作为特邀讲者,进行主题为“元宇宙场景的智能感知与呈现”的学术研讨,本次会议得到了广泛关注,吸引了多名高校师生前来参会。广东智慧教育研究院院长刘子韬教授致欢迎词,信息科学技术学院院长李哲涛教授、党委书记罗国伟等出席会议。本次活动由暨南大学网络空间安全学院/广东智慧教育研究院高博宇副教授主持。

图1 专委会成员合影

首先,高博宇副教授介绍了五位特邀嘉宾,并对他们的到来表示感谢。接着,学院党委书记罗国伟向各位专家介绍了暨南大学的发展史、信息科学技术学院和网络空间安全学院的建设情况,以及暨南大学师资队伍、平台建设、科学研究、人才培养等方面取得的成绩,期盼专委会和各位专家常来暨大指导工作。

图2 高博宇副教授主持会议

图3 罗国伟党委书记致辞

广东智慧教育研究院院长刘子韬教授在致辞中表示,虚拟现实技术对于教育和科研都有着重要的意义。他热烈欢迎各位专家的到来,并希望大家能够在本次研讨会中深入探讨虚拟现实技术的应用和发展,此外,活动还邀请专委会秘书长杨鑫教授代表专委会介绍专委会走进高校宗旨及活动情况。

图4 刘子韬教授致辞

图5 杨鑫教授代表专委会致辞

上海交通大学杨旭波教授作了“扩展现实沉浸计算技术”的特邀报告。在报告中,杨教授介绍了上海交通大学开展的相关研究成果,包括高沉浸扩展现实需要的近眼渲染与近眼显示技术、物理高度拟真的内容生成技术、多通道自然交互技术等方面。他详细介绍了FoV-NeRF技术,该技术结合了神经辐射场与注视点染的VR近眼染技术,以及支持光学透视眼镜外挂遮挡的AR近眼显示技术Addon-Occlusion。此外,他还介绍了复杂动态场景物理化学建模的MR内容生成技术Labsimulation,以及支持触觉重定向放置的XR多通道交互技术Redirected Placement。杨教授指出,未来将结合AI与XR,进一步突破近眼渲染、显示、感知交互、内容生成技术等方面,实现更高水平的沉浸计算。

图6 杨旭波教授

北京航空航天大学王莉莉教授在本次活动上作了题为“凝视点绘制技术在近眼显示中的应用”的特邀报告。她指出,用户佩戴虚拟现实头盔近眼显示时容纳的延迟低于13毫秒,否则用户会感知视觉反馈与自身动作不一致。现有实时绘制方法效率通常为30-60FPS,不能满足近眼显示要求。为此,她介绍了凝视点绘制方法,该方法可以优化计算资源分配,提高绘制效率。在报告中,王教授对凝视点绘制方法的概念、基本思路进行了介绍,并对现有研究工作进行了分析总结。她介绍了最新进展,提出了视觉感知模型驱动的高效凝视点绘制方法,该方法基于视觉敏锐度模型、对比度敏感性模型等人类视觉感知模型,采用空间-光照相关的对比度敏感性函数对多分辨率光能传播过程建模与计算,从而加快绘制速度。最后,王教授还对凝视点绘制未来工作进行了探讨。

图7 王莉莉教授

浙江大学许威威教授进行了主题为“三维内容的神经网络表达构建技术探讨”的报告。许教授首先介绍了神经隐式场的概念和基本原理,指出该技术可以将三维内容表达为一个神经网络,从而实现高效的三维场景重建、材质计算和人体重建等。随后,他介绍了研究团队在神经隐式场方面的最新进展,包括场景重建、材质计算和人体重建等方面的应用。在场景重建方面,研究团队提出了一种新的场景不可知网络,可以将场景特定优化转化为场景不可知网络的训练,从而实现更高效的场景重建。在材质计算方面,研究团队提出了一种解耦几何、材料表达的方法,可以将材质计算与几何计算分离,从而实现更高效的材质计算。在人体重建方面,研究团队提出了一种新的AIGC方法,可以快速、准确地重建人体。许教授指出,神经隐式场是未来三维内容构建的重要技术之一,未来将会有更多的研究工作聚焦于此。他还展望了未来在神经网络表达构建技术方面的工作,包括更深入的研究场景不可知网络、解耦几何、材料表达等方向。这些研究成果将有助于进一步推动三维内容构建技术的发展。

图8 许威威教授

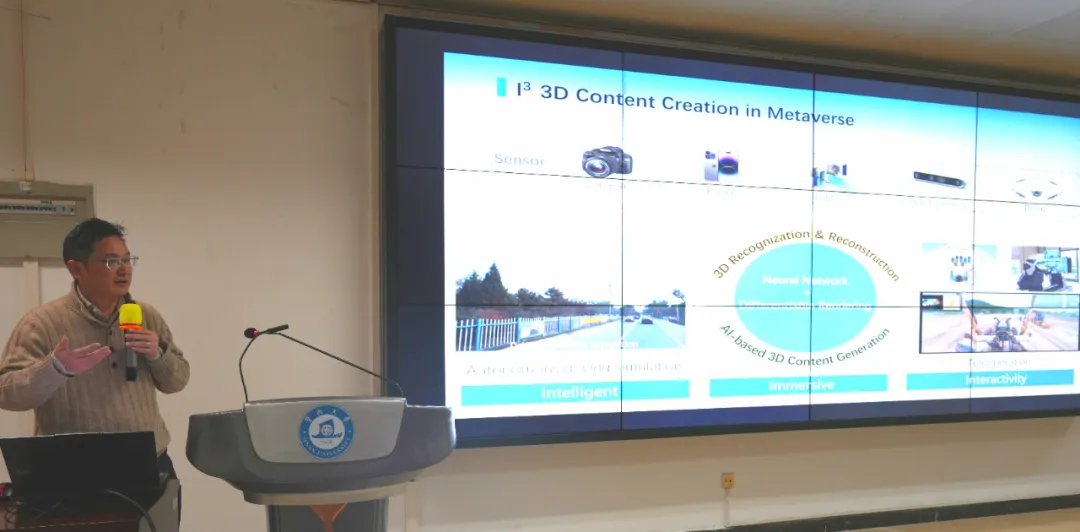

大连理工大学杨鑫教授作了“生物启发的场景交互感知”的特邀报告,分享了他在生物启发场景交互感知方面的研究成果。报告中,杨教授提到了为什么捉苍蝇如此困难。他解释说,苍蝇可以感知到人类的运动,因为它们的视觉系统可以感知到高频率的运动。这就使得苍蝇能够很快地逃脱人类的手掌,为了解决这个问题,杨教授介绍了事件驱动相机,这是一种生物启发的相机,它可以像苍蝇一样感知高频率的运动,从而更好地捕捉运动物体。杨教授还介绍了蜻蜓的视觉系统,它可以感知极化光和双眼视觉来感知深度和方向。这启发了研究人员开发更高级的感知技术,例如高动态范围处理和体感学习。高动态范围处理可以帮助相机感知更广泛的亮度范围,而体感学习可以帮助机器感知人类的动作和姿势。杨教授指出,生物启发的技术可以应用于场景交互和感知,从而提高人机交互的效率和准确性。他还表示,未来将继续研究生物学方面的知识,并将其应用于计算机科学和人工智能领域,推动技术的发展。

图9 杨鑫教授

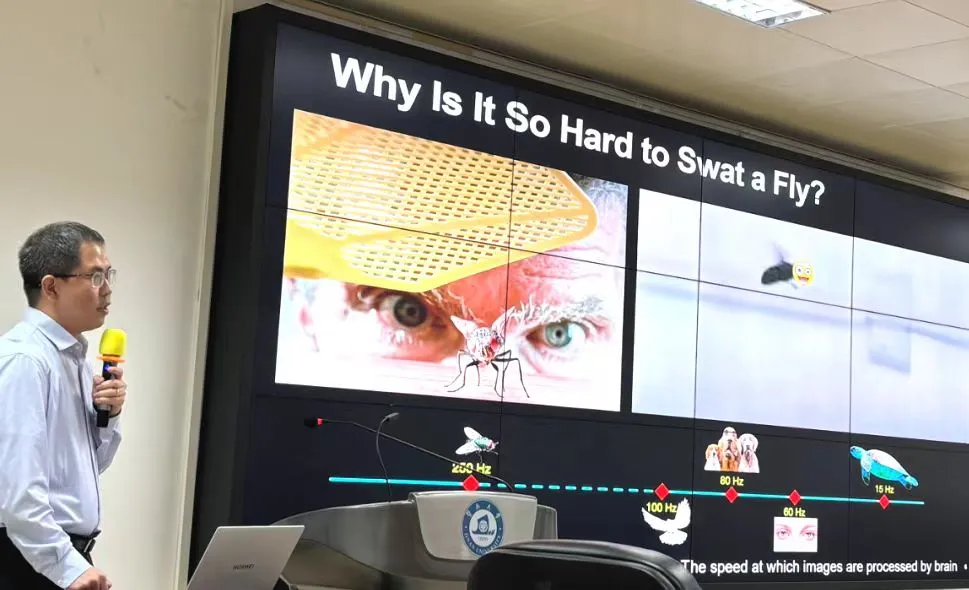

中国人民大学汪云海教授在本次活动上作了题为“视觉感知驱动的大规模科学数据可视代”的特邀报告。他介绍了Color Mapping技术以及面向高动态范围的colormap设计,旨在实现自动的colormap调整,以揭示更多的空间模式。汪教授还介绍了山东大学和苏州舜云工程软件有限公司联合实验室,苏州舜云工程软件有限公司是一家专注于流体多物理场数值软件开发的企业,已完成超过六千万元的融资。联合实验室的研究发展目标,将“应用于粒子法和欧拉法OFD的国产大规模科学计算数据可视化基础平台开发”确定为重点研究方向,重点在成果转化科研创新和人才培养方面加强合作。汪教授还分享了Rings Dataset、Curvature、Similarity和Linear Entropy等数据可视化应用,以及实时交互等关键技术。视觉感知驱动的大规模科学数据可视化是未来研究的重点,将对科学研究和实际应用产生深远的影响。

图10 汪云海教授

本次CCF CAD&CG专委会走进高校第17期活动在暨南大学顺利举办,为广大师生提供了一个学习和交流的平台。五位特邀嘉宾从不同的角度和方面,分享了他们在虚拟现实、沉浸计算、三维内容构建、生物启发技术和大规模科学数据可视化等领域的最新研究成果和探索。相信通过这次研讨会,与会者们能够更深入地了解虚拟现实技术的发展趋势和应用前景,为相关领域的研究和应用提供更多的思路和启发。